Jak nie myśleć o ryzyku przemysłowym? O heurystykach, psychologii i tych błędach, które w zakładzie kosztują najwięcej

Ostatnio, podczas audytu wstępnego u jednego z klientów, dużo uwagi poświęcaliśmy „robieniu porządku” z zagrożeniami konwencjonalnymi: cieczami łatwopalnymi, segregacją materiałów, organizacją magazynowania czy ogólną dyscypliną pożarową. W pewnym momencie zwróciłem jednak uwagę na coś, co na pierwszy rzut oka, dla klienta, nie wydawało się szczególnie problematyczne – ręczne skanery zasilane bateriami litowo-jonowymi, używane przez pracowników na co dzień. Poruszyłem ten temat jako kolejny istotny obszar z punktu widzenia bezpieczeństwa pożarowego.

Dlaczego? Bo właśnie takie urządzenia bardzo łatwo przeoczyć. Są małe, powszechne, oswojone. A jednocześnie w warunkach przemysłowych bywają szczególnie narażone. Po pierwsze, bardzo często są ładowane nocą, bez nadzoru i bez żadnych pasywnych zabezpieczeń. Po drugie, w środowisku magazynowym czy produkcyjnym nietrudno o ich upuszczenie – czasem raz, czasem wielokrotnie. A to oznacza ryzyko uszkodzenia mechanicznego, również wewnętrznego, którego nie widać gołym okiem. W praktyce może chodzić choćby o naruszenie struktury ogniwa czy separatora między jego elementami. Takie urządzenie, po uszkodzeniu, a następnie podłączone do ładowania, traktowałbym już jako wymagające szczególnej uwagi.

Klient zareagował jednak dokładnie tak, jak reaguje większość ludzi, gdy ryzyko nie pasuje do ich codziennego doświadczenia. Skoro baterie litowo-jonowe są dziś wszędzie, a świat nie pali się od nich codziennie, to może problem jest trochę przesadzony? Brzmi rozsądnie. Ale właśnie takie „rozsądne” uproszczenia są jednym z powodów, dla których o ryzyku przemysłowym myślimy gorzej, niż nam się wydaje.

Ryzyko przemysłowe nie przegrywa najczęściej z techniką. Przegrywa z intuicją

Daniel Kahneman i Amos Tversky pokazali światu coś bardzo niewygodnego: człowiek nie ocenia rzeczywistości tak racjonalnie, jak sam o sobie lubi myśleć. Zamiast tego bardzo często korzysta z heurystyk, czyli poznawczych skrótów. Te skróty bywają użyteczne w codziennym życiu, ale w ocenie zagrożeń potrafią brutalnie zawodzić. Szczególnie wtedy, gdy mówimy o zjawiskach rzadkich, technicznych i o dużych konsekwencjach.

I tu dochodzimy do sedna.

Bezpieczeństwo przemysłowe jest z definicji obszarem, w którym intuicja nie wystarcza. Ba, bardzo często to właśnie intuicja jest jednym z problemów.

Bo intuicja lubi to, co zna.

Lubi to, co już widziała.

Lubi to, co oswojone.

Lubi myśleć, i tu klasyk, który na pewno bardzo dobrze znasz: „skoro do tej pory nic się nie stało, to pewnie wszystko jest w porządku”.

A zakład przemysłowy rządzi się zupełnie inną logiką.

Tu nie wystarczy zapytać, czy coś zdarza się często. Należy natychmiast przestawić spojrzenie na – co się stanie, jeżeli już jednak do tego dojdzie.

„Mam baterię w telefonie i żyję”, czyli klasyczny błąd myślenia o ryzyku

To jest wręcz podręcznikowy przykład.

Człowiek widzi baterię li-ion w telefonie, laptopie, słuchawkach, szczoteczce, hulajnodze. Obcuje z tą technologią codziennie. Najczęściej bez żadnego incydentu. Więc jego umysł wyciąga prosty wniosek:

„No dobrze, skoro to jest wszędzie, to może to całe ryzyko pożaru jest trochę przesadzone?”

Nie jest.

Tyle że to pytanie wcale nie jest wynikiem analizy technicznej. To jest wynik psychologii. A w zasadzie błędów poznawczych, które doskwierają nam wszystkim.

Kahneman nazwałby to myśleniem opartym na tym, co łatwo przychodzi do głowy (heurystyka dostępności). Jeśli ktoś nie widział pożaru baterii, nie uczestniczył w incydencie, nie analizował zdarzenia, to jego intuicja podpowiada, że problem jest marginalny. Nie dlatego, że policzył prawdopodobieństwo i skutki. Tylko dlatego, że nie ma w pamięci odpowiednio „mocnego obrazu”.

A przecież telefon z jedną małą baterią, zamkniętą w urządzeniu zaprojektowanym jako całość, to nie to samo co:

ładowanie wielu pakietów jednocześnie,

magazynowanie większej liczby ogniw,

baterie po uszkodzeniu mechanicznym,

strefa serwisowa,

nocne ładowanie,

brak separacji,

brak odpowiedniej procedury postępowania z baterią wadliwą albo po incydencie.

I właśnie tutaj intuicja przestaje wystarczać.

Heurystyka dostępności. Czyli: nie widziałem, więc pewnie to mało realne

To jeden z najgroźniejszych błędów poznawczych w bhp.

Jeżeli czegoś nie widzieliśmy osobiście, nie słyszeliśmy o tym od znajomego albo nie wydarzyło się to „u nas”, to automatycznie spada w naszej głowie ciężar tego zagrożenia. Tak działa umysł.

I z ludzkiego punktu widzenia trudno się temu dziwić. Na co dzień nie żyjemy przecież tabelą ryzyka, matrycą skutków i analizą scenariuszową. Żyjemy doświadczeniem, żyjemy emocjami.

Problem pojawia się wtedy, gdy doświadczenie zaczyna zastępować ocenę ryzyka.

Bo w przemyśle najdroższe zagrożenia bardzo często nie są tymi, które zdarzają się codziennie. Są tymi, które długo nie dzieją się wcale, a potem dzieją się raz, za to bardzo poważnie. Przywołamy tu sobie na chwilę głośny pożar w Tarnowie Podgórnym.

To właśnie dlatego brak incydentu nie może być traktowany jako dowód braku zagrożenia.

Może być najwyżej dowodem, że tym razem się udało.

Heurystyka reprezentatywności. Czyli: znam jeden przypadek, więc rozumiem całą kategorię

Drugi klasyczny błąd wygląda tak:

skoro mała bateria w telefonie zwykle jest bezpieczna, to „baterie litowo-jonowe” jako kategoria też są zasadniczo bezpieczne,

skoro pojedyncza beczka stała kiedyś bez wanny i nic się nie rozlało, to może z tym wychwytem też trochę przesadzamy,

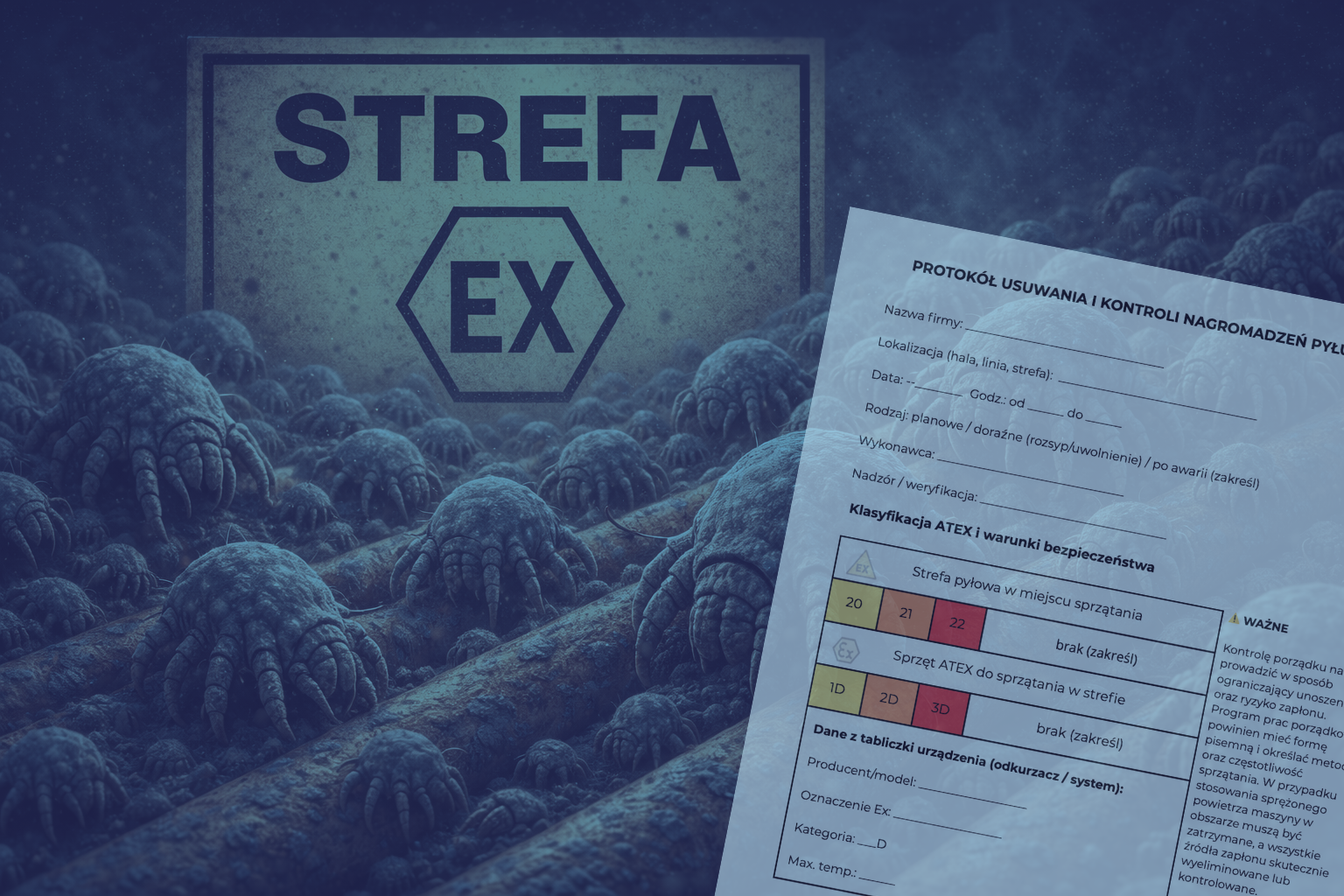

skoro pył leży od dawna i nic nie wybuchło, to może problem jest bardziej teoretyczny niż realny.

Brzmi znajomo?

To właśnie tu człowiek bierze znany sobie przypadek i zaczyna traktować go jak reprezentatywny dla całości. A przemysł takich uproszczeń nie wybacza.

Bo różnica między jednym przypadkiem a całą klasą zagrożeń potrafi być kolosalna.

Jedna bateria to nie magazyn baterii.

Jeden pojemnik to nie strefa składowania chemikaliów.

Jeden epizod bez skutków to nie dowód bezpieczeństwa procesu.

Najgroźniejsze zdanie w zakładzie? „Zawsze tak robiliśmy”

Mam wrażenie, że w wielu zakładach to zdanie powinno świecić się na czerwono.

Nie dlatego, że doświadczenie jest czymś złym. Wręcz przeciwnie. Doświadczenie jest bezcenne. Ale tylko wtedy, gdy wspiera analizę. Nie wtedy, gdy ją zastępuje.

„Zawsze tak robiliśmy” bardzo często oznacza bowiem coś innego:

do tej pory nie zapłaciliśmy jeszcze pełnej ceny za ten błąd.

I to jest ogromna różnica.

Właśnie w ten sposób organizacje zaczynają oswajać odchylenia:

ładowanie „na chwilę” poza miejscem wyznaczonym,

odkładanie uszkodzonego pakietu „byle na bok”,

brak wyraźnej segregacji baterii sprawnych i wadliwych,

pojemnik bez wychwytu, bo „przecież stoi tylko tymczasowo”,

materiał palny tam, gdzie „zaraz go zabiorą”.

Każde z tych odstępstw z osobna może wyglądać niewinnie.

Systemowo jednak robi się z tego kultura przyzwyczajenia do ryzyka.

A to już bardzo niebezpieczny etap.

Człowiek nie jest problemem. Problemem jest system, który wymaga od człowieka, by był nieomylny

To jeden z najważniejszych wniosków, jakie powinniśmy wynieść z psychologii do bezpieczeństwa przemysłowego.

Zbyt łatwo mówi się:

„ludzie muszą bardziej uważać”,

„operator powinien przewidzieć”,

„pracownik wiedział, co ma robić”.

Tylko że człowiek nie działa w próżni.

Działa pod presją czasu.

W hałasie.

W zmęczeniu.

W warunkach nie zawsze idealnych.

W otoczeniu procedur, które czasem są dobre na papierze, a gorsze w realnym procesie.

W kulturze organizacyjnej, która może nieświadomie nagradzać tempo, improwizację i obchodzenie problemów.

Dlatego w bhp nie wystarczy liczyć na ostrożność człowieka. Trzeba projektować środowisko pracy tak, by ograniczać możliwość błędu i nie budować systemu opartego na założeniu, że wszyscy zawsze wszystko zrobią idealnie.

Jak nie myśleć o ryzyku przemysłowym

Spróbujmy to zebrać w prostych punktach.

Źle myślimy o ryzyku wtedy, gdy mówimy:

„nie widziałem tego, więc problem jest mały”,

„u nas się to nigdy nie zdarzyło”,

„wszyscy mają takie baterie i nic się nie dzieje”,

„ten pojemnik stoi tu tylko chwilę”,

„przecież zawsze tak robiliśmy”,

„ludzie mają po prostu uważać”.

Każde z tych zdań brzmi niewinnie.

Każde jest psychologicznie zrozumiałe.

I każde może być początkiem bardzo kosztownej pomyłki.

Jak myśleć lepiej (bezpieczniej)

Lepsze podejście zaczyna się wtedy, gdy zamiast pytać tylko o częstotliwość, zaczynamy pytać też o skutek.

Nie:

czy to zdarza się codziennie? ❌

Tylko:

co się stanie, jeśli jednak zdarzy się dziś? ✅

Nie:

czy pracownik zna procedurę? ❌

Tylko:

czy procedura jest realistyczna, zrozumiała i możliwa do wykonania w realnych warunkach? ✅

Nie:

czy dotąd było spokojnie? ❌

Tylko:

czy naprawdę kontrolujemy ryzyko, czy tylko przyzwyczailiśmy się do jego obecności? ✅

Nie:

czy mała skala była bezpieczna? ❌

Tylko:

czy większa skala, inna konfiguracja, uszkodzenie albo kumulacja odstępstw nie zmieniają całkowicie obrazu sytuacji? ✅

Dlaczego ten temat jest tak ważny właśnie dziś

Mam wrażenie, że w najbliższych latach ten obszar będzie tylko zyskiwał na znaczeniu. Zakłady pracują szybciej, procesy stają się coraz bardziej złożone, rośnie ilość energii magazynowanej w urządzeniach, a wraz z nią liczba potencjalnych źródeł zapłonu, punktów krytycznych i miejsc kumulacji zagrożeń. Dochodzi do tego więcej chemii, więcej baterii, więcej automatyki, więcej zależności między procesami. Krótko mówiąc: środowisko przemysłowe staje się coraz trudniejsze do oceny wyłącznie „na wyczucie”.

Człowiek jednak pozostaje człowiekiem. Ewolucja naszego mózgu nie nadąża za tempem rozwoju technologicznego. Co więcej, w niektórych obszarach coraz wyraźniej widać, że funkcjonujemy pod rosnącą presją poznawczą: z deficytem uwagi, przeciążeniem bodźcami, nadmiarem informacji i coraz silniejszym ładunkiem emocjonalnym w codziennym przekazie. To nie są warunki sprzyjające spokojnej, analitycznej ocenie ryzyka.

Dlatego nadal będziemy oceniać rzeczywistość przez własne doświadczenia, skojarzenia i intuicję. Nadal będziemy upraszczać to, co złożone. Nadal będziemy mylić brak incydentu z brakiem zagrożenia.

I właśnie dlatego psychologia nie jest żadnym dodatkiem do bhp. Jest jednym z jego fundamentów. Bo zanim dojdzie do błędu technicznego, bardzo często wcześniej pojawia się błąd poznawczy.

Podsumowując

Najgroźniejsze w ryzyku przemysłowym nie jest tylko to, że bywa niewidoczne. Najgroźniejsze jest również to, że bardzo szybko staje się dla nas zwyczajne, oswojone i pozornie niegroźne. A to, co zwyczajne, przestajemy analizować z należytą ostrożnością. Właśnie dlatego bezpieczeństwo nie może opierać się wyłącznie na intuicji, przyzwyczajeniu i przekonaniu, że skoro dotąd było spokojnie, to dalej też tak będzie.

Jeżeli chcemy naprawdę poprawiać bezpieczeństwo, musimy być świadomi własnych błędów poznawczych. Potrzebna jest tu pewna pokora wobec ryzyka, wobec złożoności procesów i wobec ograniczeń naszego własnego myślenia. W praktyce oznacza to ćwiczenie uważności, rozwijanie krytycznego myślenia i regularne zadawanie sobie pytań, czy to, co uznajemy za bezpieczne, rzeczywiście takie jest, czy tylko zdążyliśmy się do tego przyzwyczaić.